Deze column is gepubliceerd als Weekendessay in Het Financieele Dagblad van zaterdag 16 oktober 2021. Volg deze link voor mijn eerdere FD columns.

De AVG is complex en blijft in veel situaties een dode letter. Een debat over de toekomstige invulling van deze privacywet is hard nodig, schrijft advocaat en onderzoeker Axel Arnbak.

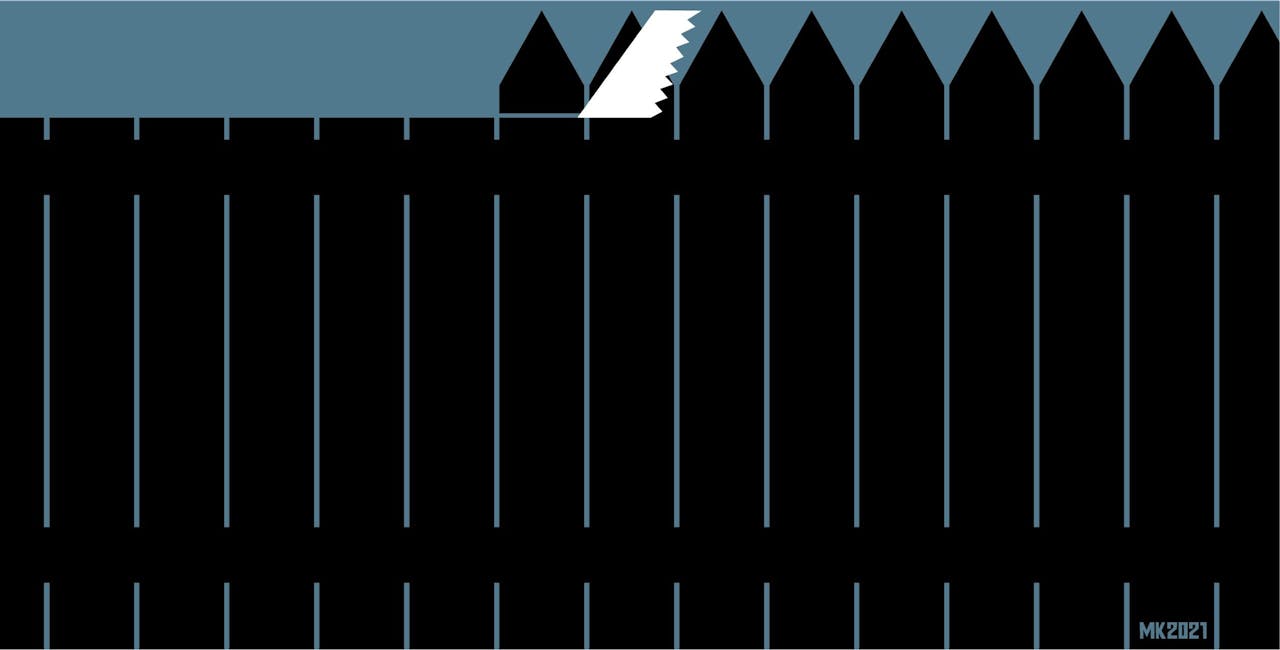

Illustratie: Max Kisman voor Het Financieele Dagblad

Wat hebben geavanceerde tumordiagnostiek, het smoelenboekje op school, coronabeleid op de werkvloer, en het wekelijkse krantje van de sportclub om de hoek met elkaar gemeen? Juist: privacy. Zodra er persoonsgegevens in het spel zijn, komt de strenge en ingewikkelde AVG (Algemene Verordening Gegevensbescherming) om de hoek kijken. Deze privacywet trad in mei 2018 in werking.

Hoe kan het gebeuren dat radiologen ondanks spectaculaire resultaten kunstmatige intelligentie nauwelijks durven in te zetten bij het diagnosticeren van tumoren? Dat ouders geen smoelenboekje meer krijgen van de klas van hun kind? Dat werkgevers grote moeite hebben popelende collega’s toe te laten op de werkvloer? En dat de naam van een overigens trotse doelpuntenmaker niet meer wordt gepubliceerd in het weekkrantje van de voetbalclub? Juist, de AVG.

Weliswaar staat de AVG ook veel datapraktijken toe, maar voor professionals en gewone mensen zonder toegang tot hoogwaardige datajuristen is de AVG zo’n groot obstakel, dat zij de AVG aan hun laars lappen of de handdoek in de ring gooien. Zo dreigt de AVG een dode letter te worden voor grote groepen organisaties en burgers.

Deze ontwikkeling baart privacywetenschappers al jarenlang zorgen. Dat is niet omdat wij tegen privacy zijn, of tegen de over het algemeen verrassend goed functionerende AVG bij het reguleren van de grote datakwesties van deze tijd. Het is omdat juist alledaagse of multidisciplinaire kwesties door de AVG in het gedrang komen.

Buitensporig

In een advies van vorige week sloeg de hoogste adviseur van het Europees Hof van Justitie van de EU, de advocaat-generaal Michal Bobek, de spijker op zijn kop: ‘Het draagt niet bij aan het gezag of de legitimiteit van wetgeving, inclusief de AVG, wanneer die wordt genegeerd wegens het buitensporige karakter ervan.’ De oplossing voor deze buitensporigheid is tweezijdig: beperk de werkingssfeer van de AVG en maak niet van ieder dataprobleem meteen een AVG-kwestie. Deze ingrepen zijn hard nodig voor de draagkracht van privacy in onze datasamenleving, en om de zombievorming van de AVG tegen te gaan.

De Tilburgse hoogleraar Bert-Jaap Koops schreef al in 2014 een nog steeds actuele en geestige kritiek op de voorstellen van de Europese Unie voor een nieuwe privacywet, die twee jaar later zouden uitmonden in de AVG. In zijn essay ‘The trouble with European data protection law’, vergelijkt Koops de AVG met de zombie uit de film The Trouble with Harry (1955) van Alfred Hitchcock. Het ‘probleem met Harry’ was dat de hoofdpersonen maar niet van het levenloze lichaam van zombie Harry afkwamen. Met een knipoog naar de film, waarschuwde Koops dat langzamerhand alle gegevens op zichzelf of in combinatie met andere data binnen de ruime definitie van ‘persoonsgegeven’ vallen.

Remmende werking

Zo kan de AVG regulerende luiheid in de hand werken, omdat politici en bestuurders, bewust of onbewust, complexe en multidisciplinaire kwesties als tumoronderzoek, toegang tot financiële producten of coronapreventie vooral zien door de lens van de AVG als een issue van transparantie en toestemming. In plaats van te beseffen dat de volksgezondheid of eerlijke kansen bij een hypotheek soms vergen dat een arts of bank geavanceerde data-analyse van gevoelige data moeten toepassen. En dat daarvoor sectorspecifieke wetgeving nodig is.

‘Het demissionair kabinet verbreekt weer de belofte om de Autoriteit Persoonsgegevens meer budget te geven’

Daarnaast is de strenge privacywet AVG ook in weinig zorgwekkende relaties volledig van kracht. Alleen in het eigen huishouden achter de voordeur is de AVG niet van toepassing. Maar de AVG biedt geen uitzondering, of lichter regime, voor een lokale sportclub of buurtinitiatief.

Een paar weken geleden publiceerde advocaat-generaal Bobek, die al talloze invloedrijke data-adviezen schreef over de datasamenleving die het EU-Hof vervolgens overnam in haar uitspraken, een warm aanbevolen en diepzinnige opinie over ‘het probleem’ van de AVG. ‘Mensen zijn sociale wezens (..). Moet nagenoeg elke uitwisseling van informatie onder de AVG vallen?’, zo schreef hij.

Bobek laat zien dat de AVG ook integraal van toepassing is op een cafégesprek, waarbij disgenoten elkaar een berichtje laten zien van een buurman en daarop een ‘weinig vleiende opmerking’ volgt. AVG overtreding, want zij hadden eerst toestemming moeten vragen aan die buurman vóór het tonen van dat appje. Bobek bespreekt een aantal van dit soort voorbeelden en noemt de vergaande reikwijdte van de AVG ‘bizar’, juist vanwege haar alomvattendheid. Hij voorspelt dat de AVG ‘feitelijk een van de meest veronachtzaamde’ wetten van de EU wordt.

Hij adviseert de Europese wetgever met klem om bij de aanstaande herziening van de AVG deze alomvattendheid te begrenzen. Dit kan bijvoorbeeld door niet-geautomatiseerde gegevensverwerkingen (het cafégesprek) uit te zonderen, te focussen op ‘behoorlijk gebruik’ in plaats van het begrip persoonsgegeven, en het aanbrengen van andere ‘minimumdrempels’, zoals daadwerkelijk nadeel (zoals schade). Bobek acht dit broodnodig, opdat de Europese privacyregels zich kunnen ‘heroriënteren op de activiteiten waarvoor zij eigenlijk waren bedoeld’.

Precies in die laatste opmerking wringt in de dagelijkse praktijk vaak de schoen. Enerzijds gooien tumoronderzoekers, leerkrachten, werkgevers en voetbalclubs hun innovaties, leuke plannen of privacy vanwege de AVG in de prullenbak. Anderzijds komt de aanpak van de grote datakwesties maar mondjesmaat op gang.

Meer geld

Tot ieders ongenoegen brak het demissionair kabinet met Prinsjesdag, voor de zoveelste keer en tegen de wens van de Tweede Kamer, zijn belofte om het budget van de Autoriteit Persoonsgegevens significant uit te breiden. Er komt geen stuiver bij terwijl een verviervoudiging van het budget noodzakelijk is. Dat is dodelijk voor de draagkracht van de AVG. Het is de hoogste tijd voor debat over de heroriëntatie van de AVG op de reële problemen en excessen van de datawereld, voordat de privacywet als een zombie door de datasamenleving rondwaart.

Illustratie: Hein de kort voor Het Financieele Dagblad

Illustratie: Hein de kort voor Het Financieele Dagblad Illustratie: Hein de Kort voor het Financieele Dagblad

Illustratie: Hein de Kort voor het Financieele Dagblad Illustratie: Hein de Kort voor Het Financieele Dagblad

Illustratie: Hein de Kort voor Het Financieele Dagblad Foto: Amr Alfiky/The New York Times uit het Financieele Dagblad

Foto: Amr Alfiky/The New York Times uit het Financieele Dagblad